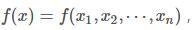

对于一个多元函数 用牛顿法求其极小值的迭代格式为 其中 为函数 的梯度向量, 为函数 的Hesse(Hessian)矩阵。 上述牛顿法不是全局收敛的。为此可以引入阻尼牛顿法(又称带步长的牛

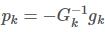

对于一个多元函数  用牛顿法求其极小值的迭代格式为

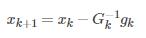

用牛顿法求其极小值的迭代格式为

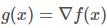

其中  为函数

为函数  的梯度向量,

的梯度向量,  为函数

为函数  的Hesse(Hessian)矩阵。

的Hesse(Hessian)矩阵。

上述牛顿法不是全局收敛的。为此可以引入阻尼牛顿法(又称带步长的牛顿法)。

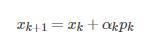

我们知道,求极值的一般迭代格式为

其中  为搜索步长,

为搜索步长, 为搜索方向(注意所有的迭代格式都是先计算搜索方向,再计算搜索步长,如同瞎子下山一样,先找到哪个方向可行下降,再决定下几步)。

为搜索方向(注意所有的迭代格式都是先计算搜索方向,再计算搜索步长,如同瞎子下山一样,先找到哪个方向可行下降,再决定下几步)。

取下降方向  即得阻尼牛顿法,只不过搜索步长

即得阻尼牛顿法,只不过搜索步长  不确定,需要用线性搜索技术确定一个较优的值,比如精确线性搜索或者Goldstein搜索、Wolfe搜索等。特别地,当

不确定,需要用线性搜索技术确定一个较优的值,比如精确线性搜索或者Goldstein搜索、Wolfe搜索等。特别地,当  一直取为常数1时,就是普通的牛顿法。

一直取为常数1时,就是普通的牛顿法。

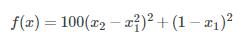

以Rosenbrock函数为例,即有

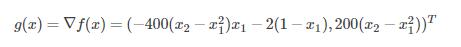

于是可得函数的梯度

函数 的Hesse矩阵为

的Hesse矩阵为

编写Python代码如下(使用版本为Python3.3):

"""

Newton法

Rosenbrock函数

函数 f(x)=100*(x(2)-x(1).^2).^2+(1-x(1)).^2

梯度 g(x)=(-400*(x(2)-x(1)^2)*x(1)-2*(1-x(1)),200*(x(2)-x(1)^2))^(T)

"""

import numpy as np

import matplotlib.pyplot as plt

def jacobian(x):

return np.array([-400*x[0]*(x[1]-x[0]**2)-2*(1-x[0]),200*(x[1]-x[0]**2)])

def hessian(x):

return np.array([[-400*(x[1]-3*x[0]**2)+2,-400*x[0]],[-400*x[0],200]])

X1=np.arange(-1.5,1.5+0.05,0.05)

X2=np.arange(-3.5,2+0.05,0.05)

[x1,x2]=np.meshgrid(X1,X2)

f=100*(x2-x1**2)**2+(1-x1)**2; # 给定的函数

plt.contour(x1,x2,f,20) # 画出函数的20条轮廓线

def newton(x0):

print('初始点为:')

print(x0,'\n')

W=np.zeros((2,10**3))

i = 1

imax = 1000

W[:,0] = x0

x = x0

delta = 1

alpha = 1

while i<imax and delta>10**(-5):

p = -np.dot(np.linalg.inv(hessian(x)),jacobian(x))

x0 = x

x = x + alpha*p

W[:,i] = x

delta = sum((x-x0)**2)

print('第',i,'次迭代结果:')

print(x,'\n')

i=i+1

W=W[:,0:i] # 记录迭代点

return W

x0 = np.array([-1.2,1])

W=newton(x0)

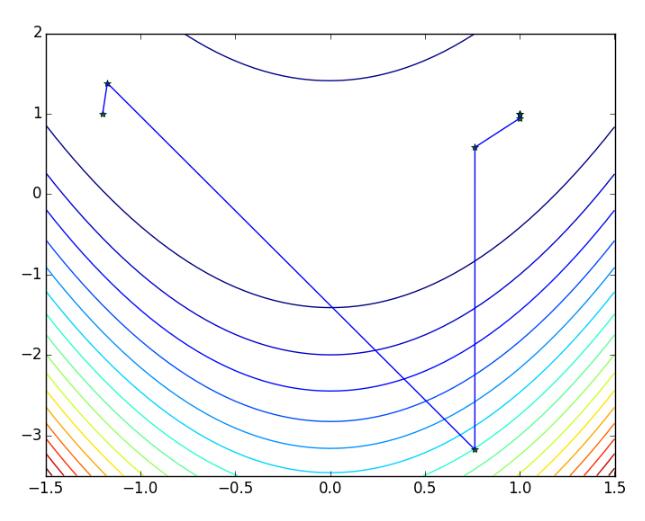

plt.plot(W[0,:],W[1,:],'g*',W[0,:],W[1,:]) # 画出迭代点收敛的轨迹

plt.show()

上述代码中jacobian(x)返回函数的梯度,hessian(x)返回函数的Hesse矩阵,用W矩阵记录迭代点的坐标,然后画出点的搜索轨迹。

可得输出结果为

初始点为: [-1.2 1. ] 第 1 次迭代结果: [-1.1752809 1.38067416] 第 2 次迭代结果: [ 0.76311487 -3.17503385] 第 3 次迭代结果: [ 0.76342968 0.58282478] 第 4 次迭代结果: [ 0.99999531 0.94402732] 第 5 次迭代结果: [ 0.9999957 0.99999139] 第 6 次迭代结果: [ 1. 1.]

即迭代了6次得到了最优解,画出的迭代点的轨迹如下:

由于主要使用了Python的Numpy模块来进行计算,可以看出,代码和最终的图与Matlab是很相像的。

以上这篇使用Python实现牛顿法求极值就是小编分享给大家的全部内容了,希望能给大家一个参考,也希望大家多多支持易盾网络。