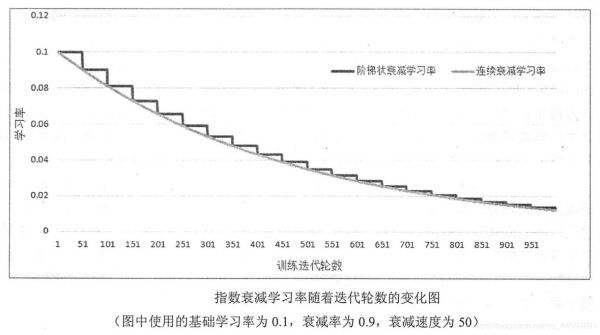

在TensorFlow中,tf.train.exponential_decay函数实现了指数衰减学习率,通过这个函数,可以先使用较大的学习率来快速得到一个比较优的解,然后随着迭代的继续逐步减小学习率,使得模型在训练后期更加稳定。

tf.train.exponential_decay(learning_rate, global_step, decay_steps, decay_rate, staircase, name)函数会指数级地减小学习率,它实现了以下代码的功能:

#tf.train.exponential_decay函数可以通过设置staircase参数选择不同的学习率衰减方式

#staircase参数为False(默认)时,选择连续衰减学习率:

decayed_learning_rate = learning_rate * math.pow(decay_rate, global_step / decay_steps)

#staircase参数为True时,选择阶梯状衰减学习率:

decayed_learning_rate = learning_rate * math.pow(decay_rate, global_step // decay_steps)

①decayed_leaming_rate为每一轮优化时使用的学习率;

②leaming_rate为事先设定的初始学习率;

③decay_rate为衰减系数;

④global_step为当前训练的轮数;

⑤decay_steps为衰减速度,通常代表了完整的使用一遍训练数据所需要的迭代轮数,这个迭代轮数也就是总训练样本数除以每一个batch中的训练样本数,比如训练数据集的大小为128,每一个batch中样例的个数为8,那么decay_steps就为16。

当staircase参数设置为True,使用阶梯状衰减学习率时,代码的含义是每完整地过完一遍训练数据即每训练decay_steps轮,学习率就减小一次,这可以使得训练数据集中的所有数据对模型训练有相等的作用;当staircase参数设置为False,使用连续的衰减学习率时,不同的训练数据有不同的学习率,而当学习率减小时,对应的训练数据对模型训练结果的影响也就小了。

接下来看一看tf.train.exponential_decay函数应用的两种形态(省略部分代码):

①第一种形态,global_step作为变量被优化,在这种形态下,global_step是变量,在minimize函数中传入global_step将自动更新global_step参数(global_step每轮迭代自动加一),从而使得学习率也得到相应更新:

import tensorflow as tf

.

.

.

#设置学习率

global_step = tf.Variable(tf.constant(0))

learning_rate = tf.train.exponential_decay(0.01, global_step, 16, 0.96, staircase=True)

#定义反向传播算法的优化方法

train_step = tf.train.AdamOptimizer(learning_rate).minimize(cross_entropy, global_step=global_step)

.

.

.

#创建会话

with tf.Session() as sess:

.

.

.

for i in range(STEPS):

.

.

.

#通过选取的样本训练神经网络并更新参数

sess.run(train_step, feed_dict={x:X[start:end], y_:Y[start:end]})

.

.

.

②第二种形态,global_step作为占位被feed,在这种形态下,global_step是占位,在调用sess.run(train_step)时使用当前迭代的轮数i进行feed:

import tensorflow as tf

.

.

.

#设置学习率

global_step = tf.placeholder(tf.float32, shape=())

learning_rate = tf.train.exponential_decay(0.01, global_step, 16, 0.96, staircase=True)

#定义反向传播算法的优化方法

train_step = tf.train.AdamOptimizer(learning_rate).minimize(cross_entropy)

.

.

.

#创建会话

with tf.Session() as sess:

.

.

.

for i in range(STEPS):

.

.

.

#通过选取的样本训练神经网络并更新参数

sess.run(train_step, feed_dict={x:X[start:end], y_:Y[start:end], global_step:i})

.

.

.

总结

以上所述是小编给大家介绍的TensorFlow实现指数衰减学习率的方法,希望对大家有所帮助!