十年河东,十年河西,莫欺少年穷

学无止境,精益求精

参考文档:https://www.yuque.com/fairy-era/yg511q/hg3u04

- Kubernetes集群大致分为两类:一主多从和多主多从。

- 一主多从:一个Master节点和多台Node节点,搭建简单,但是有单机故障风险,适合用于测试环境。

- 多主多从:多台Master和多台Node节点,搭建麻烦,安全性高,适合用于生产环境。

本篇采用一主二从模式进行,该模式用于测试环境,真实环境还得是多主多从,防止单点故障

k8s环境准备 1、准备三台虚拟机,分别命名为master 、 node1 、 node2master 192.168.136.135

node1 192.168.136.136

node2 192.168.136.137

[root@localhost ~]# cat /etc/redhat-release CentOS Linux release 7.9.2009 (Core)3、三台服务器上设置分别设置主机名及主机名解析 设置主机名

- 设置192.168.136.135 的主机名:

hostnamectl set-hostname master

- 设置192.168.136.136 的主机名:

hostnamectl set-hostname node1

- 设置192.168.136.137 的主机名:

hostnamectl set-hostname node2

主机名解析(三台服务器均要执行)

vim /etc/hosts

在三台虚拟机的 hosts 文件中增加如下配置

192.168.136.135 master 192.168.136.136 node1 192.168.136.137 node2

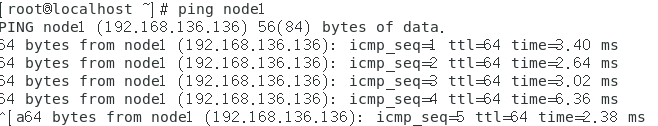

此时三台虚拟机可以相互 ping 通

我在master 中 ping node1虚拟机

关闭

systemctl stop firewalld

禁用

systemctl disable firewalld5、三台服务器上进行时间同步

安装时间插件

yum install ntpdate -y

同步时间

ntpdate time.windows.com6、三台服务器上关闭selinux 查看selinux是否开启

getenforce永久关闭selinux,需要重启

sed -i 's/enforcing/disabled/' /etc/selinux/config临时关闭selinux,重启之后,无效

setenforce 0

这里采用永久关闭,关闭后暂不重启,配置完后,一块重启

7、三台服务器上关闭swap分区

- 永久关闭swap分区,需要重启:

sed -ri 's/.*swap.*/#&/' /etc/fstab

- 临时关闭swap分区,重启之后,无效::

swapoff -a这里采用永久关闭,关闭后暂不重启,配置完后,一块重启 8、三台服务器上将桥接的IPv4流量传递到iptables的链

- 在每个节点上将桥接的IPv4流量传递到iptables的链:

cat > /etc/sysctl.d/k8s.conf << EOF net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1 net.ipv4.ip_forward = 1 vm.swappiness = 0 EOF

加载br_netfilter模块

# 加载br_netfilter模块

modprobe br_netfilter

查看是否加载

# 查看是否加载

lsmod | grep br_netfilter

生效

# 生效

sysctl --system

9、三台服务器上开启ipvs

- 在kubernetes中service有两种代理模型,一种是基于iptables,另一种是基于ipvs的。ipvs的性能要高于iptables的,但是如果要使用它,需要手动载入ipvs模块。

- 在每个节点安装ipset和ipvsadm:

yum -y install ipset ipvsadm

- 在所有节点执行如下脚本:

cat > /etc/sysconfig/modules/ipvs.modules <<EOF #!/bin/bash modprobe -- ip_vs modprobe -- ip_vs_rr modprobe -- ip_vs_wrr modprobe -- ip_vs_sh modprobe -- nf_conntrack_ipv4 EOF

- 授权、运行、检查是否加载:

chmod 755 /etc/sysconfig/modules/ipvs.modules && bash /etc/sysconfig/modules/ipvs.modules && lsmod | grep -e ip_vs -e nf_conntrack_ipv4

- 检查是否加载:

lsmod | grep -e ipvs -e nf_conntrack_ipv410、重启三台服务器

reboot

以上便完成了K8s环境的搭建

三台服务器上安装K8s所需的组件,Docker、kubeadm、kubelet和kubectl 11、三台服务器上安装docker指定阿里云加速

wget https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo -O /etc/yum.repos.d/docker-ce.repo

安装指定版本

yum -y install docker-ce-18.06.3.ce-3.el7

开机自启动docker

systemctl enable docker && systemctl start docker

查看docker 版本

docker version

- 设置Docker镜像加速器:

mkdir -p /etc/docker

设置阿里云Yum源 【可登录自己的阿里云,搜索容器镜像服务,配置docker镜像加速器】

sudo tee /etc/docker/daemon.json <<-'EOF' { "exec-opts": ["native.cgroupdriver=systemd"], "registry-mirrors": ["https://du3ia00u.mirror.aliyuncs.com"], "live-restore": true, "log-driver":"json-file", "log-opts": {"max-size":"500m", "max-file":"3"}, "storage-driver": "overlay2" } EOF

加载docker配置 并 重启docekr

sudo systemctl daemon-reload

重启docker

sudo systemctl restart docker12、三台服务器上安装 kubeadm、kubelet和kubectl 三个组件 添加阿里云的YUM软件源

- 由于kubernetes的镜像源在国外,非常慢,这里切换成国内的阿里云镜像源:

cat > /etc/yum.repos.d/kubernetes.repo << EOF [kubernetes] name=Kubernetes baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64 enabled=1 gpgcheck=0 repo_gpgcheck=0 gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg EOF安装kubeadm、kubelet和kubectl

- 由于版本更新频繁,这里指定版本号部署:

yum install -y kubelet-1.18.0 kubeadm-1.18.0 kubectl-1.18.0

- 为了实现Docker使用的cgroup drvier和kubelet使用的cgroup drver一致,建议修改"/etc/sysconfig/kubelet"文件的内容:

vim /etc/sysconfig/kubelet

修改文件内容为:

KUBELET_EXTRA_ARGS="--cgroup-driver=systemd" KUBE_PROXY_MODE="ipvs"

- 设置为开机自启动即可,由于没有生成配置文件,集群初始化后自动启动:

systemctl enable kubelet至此,K8s的四个组件安装及配置完毕 部署K8s集群 13、部署K8s集群的Master节点

查看K8s所需镜像

kubeadm config images list

14、部署K8s Master 节点【只需在Master节点执行即可,我的master节点的Ip地址为:192.168.136.135】

# 由于默认拉取镜像地址k8s.gcr.io国内无法访问,这里需要指定阿里云镜像仓库地址 kubeadm init \ --apiserver-advertise-address=192.168.136.135 \ --image-repository registry.aliyuncs.com/google_containers \ --kubernetes-version v1.18.0 \ --service-cidr=10.96.0.0/12 \ --pod-network-cidr=10.244.0.0/16

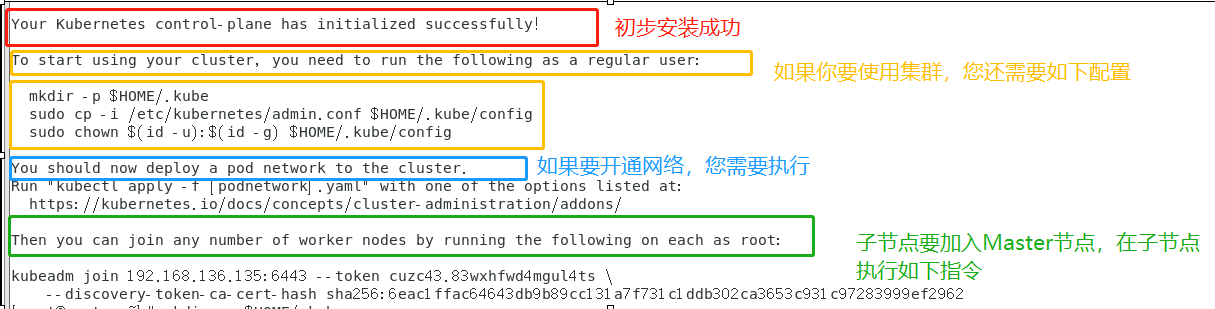

根据提示,在master节点上做如下配置

mkdir -p $HOME/.kube sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config14、部署K8s集群的Node节点,Node节点加入集群

sudo chown $(id -u):$(id -g) $HOME/.kube/config

在两个Node节点,执行Master节点的提示语句,使子节点加入master集群

kubeadm join 192.168.136.135:6443 --token cuzc43.83wxhfwd4mgul4ts \ --discovery-token-ca-cert-hash sha256:6eac1ffac64643db9b89cc131a7f731c1ddb302ca3653c931c97283999ef2962

- 默认的token有效期为2小时,当过期之后,该token就不能用了,这时可以使用如下的命令创建token:

kubeadm token create --print-join-command

当然,为了防止以后其他子节点加入时Token过期,我们生产一个永不过期的token

# 生成一个永不过期的token kubeadm token create --ttl 0 --print-join-command

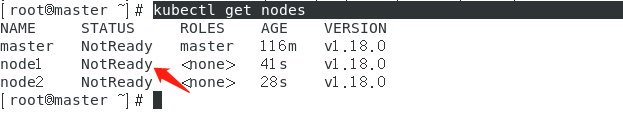

执行完毕后,在Master节点查看子节点的信息

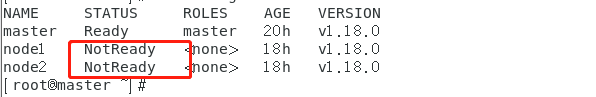

kubectl get nodes

ok,截止到这儿,k8s节点集群就初步完成了。但三个节点的状态都是NotReady ,为什么?

15、部署CNI网络插件- kubernetes支持多种网络插件,比如flannel、calico、canal等,任选一种即可,本次选择flannel,

- 在Master节点上获取flannel配置文件(可能会失败,如果失败,请下载到本地,然后安装):

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

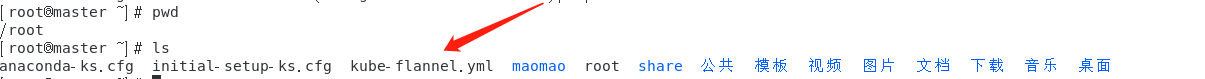

执行上述指令时如果失败了,则通过百度搜索 kube-flannel.yml ,找到该文件后,上传至 Master 服务器的root 根目录下

kube-flannel.yml 文件内容为:

--- apiVersion: policy/v1beta1 kind: PodSecurityPolicy metadata: name: psp.flannel.unprivileged annotations: seccomp.security.alpha.kubernetes.io/allowedProfileNames: docker/default seccomp.security.alpha.kubernetes.io/defaultProfileName: docker/default apparmor.security.beta.kubernetes.io/allowedProfileNames: runtime/default apparmor.security.beta.kubernetes.io/defaultProfileName: runtime/default spec: privileged: false volumes: - configMap - secret - emptyDir - hostPath allowedHostPaths: - pathPrefix: "/etc/cni/net.d" - pathPrefix: "/etc/kube-flannel" - pathPrefix: "/run/flannel" readOnlyRootFilesystem: false # Users and groups runAsUser: rule: RunAsAny supplementalGroups: rule: RunAsAny fsGroup: rule: RunAsAny # Privilege Escalation allowPrivilegeEscalation: false defaultAllowPrivilegeEscalation: false # Capabilities allowedCapabilities: ['NET_ADMIN', 'NET_RAW'] defaultAddCapabilities: [] requiredDropCapabilities: [] # Host namespaces hostPID: false hostIPC: false hostNetwork: true hostPorts: - min: 0 max: 65535 # SELinux seLinux: # SELinux is unused in CaaSP rule: 'RunAsAny' --- kind: ClusterRole apiVersion: rbac.authorization.k8s.io/v1 metadata: name: flannel rules: - apiGroups: ['extensions'] resources: ['podsecuritypolicies'] verbs: ['use'] resourceNames: ['psp.flannel.unprivileged'] - apiGroups: - "" resources: - pods verbs: - get - apiGroups: - "" resources: - nodes verbs: - list - watch - apiGroups: - "" resources: - nodes/status verbs: - patch --- kind: ClusterRoleBinding apiVersion: rbac.authorization.k8s.io/v1 metadata: name: flannel roleRef: apiGroup: rbac.authorization.k8s.io kind: ClusterRole name: flannel subjects: - kind: ServiceAccount name: flannel namespace: kube-system --- apiVersion: v1 kind: ServiceAccount metadata: name: flannel namespace: kube-system --- kind: ConfigMap apiVersion: v1 metadata: name: kube-flannel-cfg namespace: kube-system labels: tier: node app: flannel data: cni-conf.json: | { "name": "cbr0", "cniVersion": "0.3.1", "plugins": [ { "type": "flannel", "delegate": { "hairpinMode": true, "isDefaultGateway": true } }, { "type": "portmap", "capabilities": { "portMappings": true } } ] } net-conf.json: | { "Network": "10.244.0.0/16", "Backend": { "Type": "vxlan" } } --- apiVersion: apps/v1 kind: DaemonSet metadata: name: kube-flannel-ds namespace: kube-system labels: tier: node app: flannel spec: selector: matchLabels: app: flannel template: metadata: labels: tier: node app: flannel spec: affinity: nodeAffinity: requiredDuringSchedulingIgnoredDuringExecution: nodeSelectorTerms: - matchExpressions: - key: kubernetes.io/os operator: In values: - linux hostNetwork: true priorityClassName: system-node-critical tolerations: - operator: Exists effect: NoSchedule serviceAccountName: flannel initContainers: - name: install-cni image: quay.io/coreos/flannel:v0.14.0 command: - cp args: - -f - /etc/kube-flannel/cni-conf.json - /etc/cni/net.d/10-flannel.conflist volumeMounts: - name: cni mountPath: /etc/cni/net.d - name: flannel-cfg mountPath: /etc/kube-flannel/ containers: - name: kube-flannel image: quay.io/coreos/flannel:v0.14.0 command: - /opt/bin/flanneld args: - --ip-masq - --kube-subnet-mgr resources: requests: cpu: "100m" memory: "50Mi" limits: cpu: "100m" memory: "50Mi" securityContext: privileged: false capabilities: add: ["NET_ADMIN", "NET_RAW"] env: - name: POD_NAME valueFrom: fieldRef: fieldPath: metadata.name - name: POD_NAMESPACE valueFrom: fieldRef: fieldPath: metadata.namespace volumeMounts: - name: run mountPath: /run/flannel - name: flannel-cfg mountPath: /etc/kube-flannel/ volumes: - name: run hostPath: path: /run/flannel - name: cni hostPath: path: /etc/cni/net.d - name: flannel-cfg configMap: name: kube-flannel-cfgView Code

可以新建一个文本文件,粘贴内容后,修改文件类型后,上传至服务器

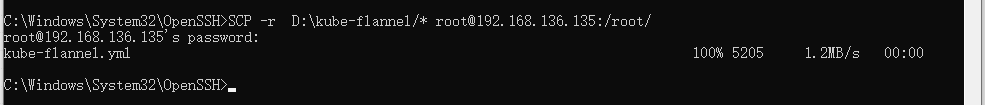

通过scp命令,上传至Master服务器

在root目录下执行如下语句,修改kube-flannel.yml中的镜像仓库地址为国内源

sed -i 's/quay.io/quay-mirror.qiniu.com/g' kube-flannel.yml

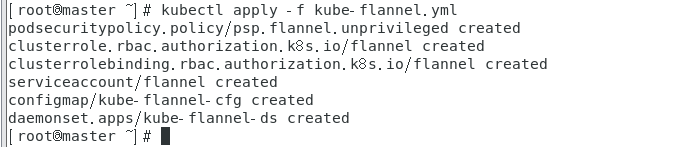

然后在root目录执行命令

kubectl apply -f kube-flannel.yml

安装完成后,重启 kubelet

systemctl restart kubelet

再次查看各节点状态

kubectl get nodes

还是NotReady ,怎么解决?

查看 kubelet 日志

journalctl -xefu kubelet

输入以下指令,查看 k8s 的 Pod 运行状态

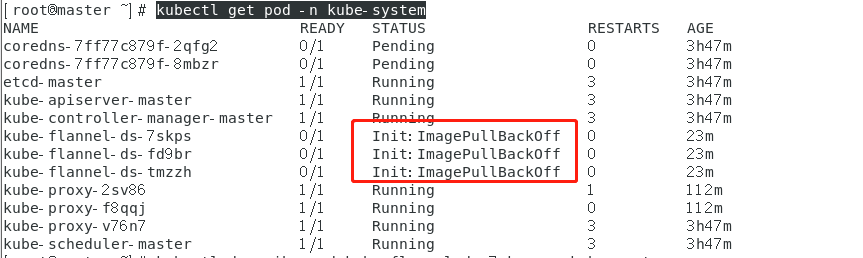

kubectl get pod -n kube-system

可以看到 pod kube-flannel 的状态是ImagePullBackoff,意思是镜像拉取失败了

后来,查了大量资料,终于解决了这个问题。

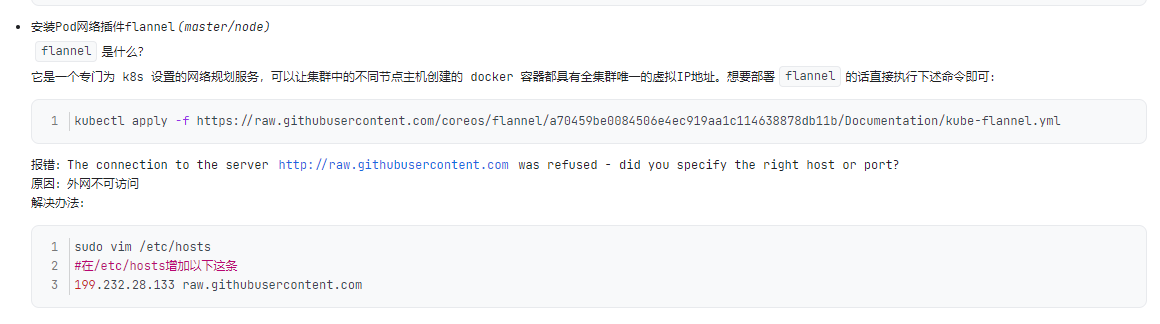

按照上图,在/etc/hosts 文件中添加DNS解析,如下:

sudo vim /etc/hosts #在/etc/hosts增加以下这条 199.232.28.133 raw.githubusercontent.com

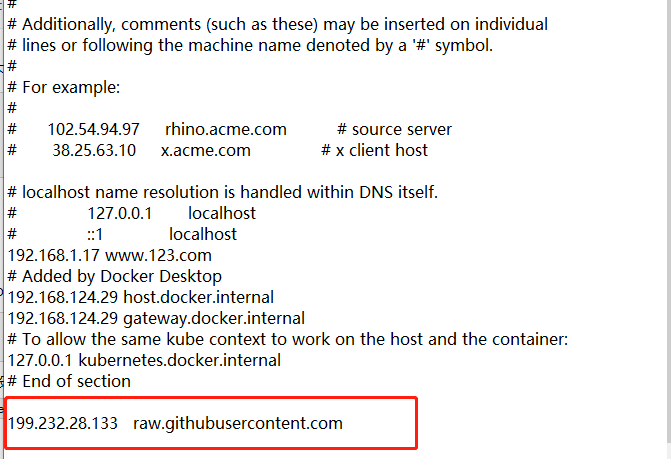

在自己的电脑中 C:\Windows\System32\drivers\etc 目录下的 hosts文件中同样增加这个DNS解析,这样有助于你通过 https://raw.githubusercontent.com 网站下载 .yml 文件

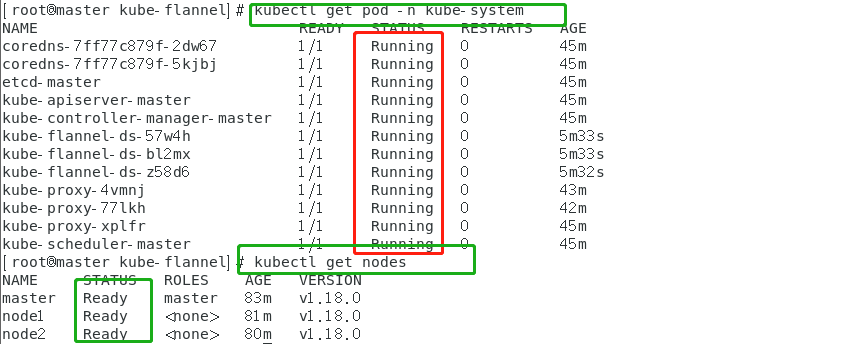

然后,将kube-flannel.yml中的 quay-mirror.qiniu.com 替换为 quay.io ,并再次执行:

kubectl apply -f kube-flannel.yml

等个五分钟左右,查看Nodes节点状态,居然奇迹般的变成了 Ready,整个过程具体发生了什么,我也不清楚,总之成功了。

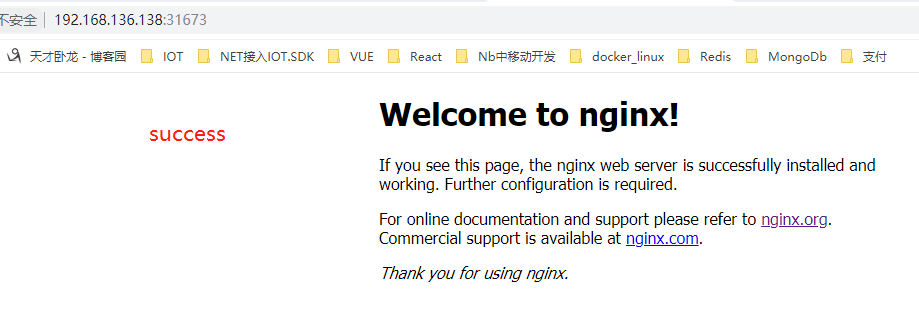

最后,我们通过K8s,部署一个Nginx服务,测试下集群是否部署成功。

16、在master节点部署一个Nginx- 部署Nginx:

kubectl create deployment nginx --image=nginx:1.14-alpine

- 暴露端口:

kubectl expose deployment nginx --port=80 --type=NodePort

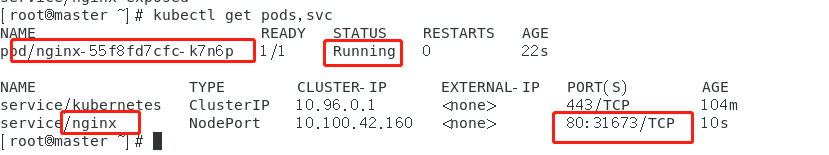

- 查看服务状态:

kubectl get pods,svc

访问 Master 服务器的 31673 端口,查看Nginx是否部署成功。

参考博客:https://blog.csdn.net/u012034742/article/details/121230873

参考博客:https://blog.csdn.net/m0_49217529/article/details/110557431

参考博客:https://zhuanlan.zhihu.com/p/265968760

参考博客:https://www.jianshu.com/p/bbd79e0444ea?ivk_sa=1024320u

@天才卧龙的博客

只爱少妇