目录 前言 1 神经网络 1.1 M-P神经元 1.2 感知机 1.3 神经网络 2 总结 前言 小小建议:配套西瓜书和南瓜书一起食用 详读西瓜书+南瓜书

目录

前言

1 神经网络

1.1 M-P神经元

1.2 感知机

1.3 神经网络

2 总结

前言

小小建议:配套西瓜书和南瓜书一起食用

详读西瓜书+南瓜书第5章(3天)

学习说明:预习,再看直播回放

预习:西瓜书5.1、5.2、5.3 直播回放:https://www.bilibili.com/video/BV1Mh411e7VU?p=7

1 神经网络

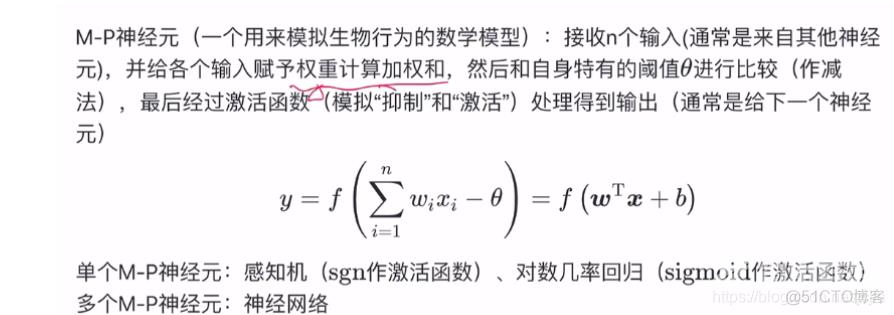

1.1 M-P神经元

上面的对数几率回归也是逻辑回归,是二分类喔

多个神经元组合出来的数学模型叫神经网络

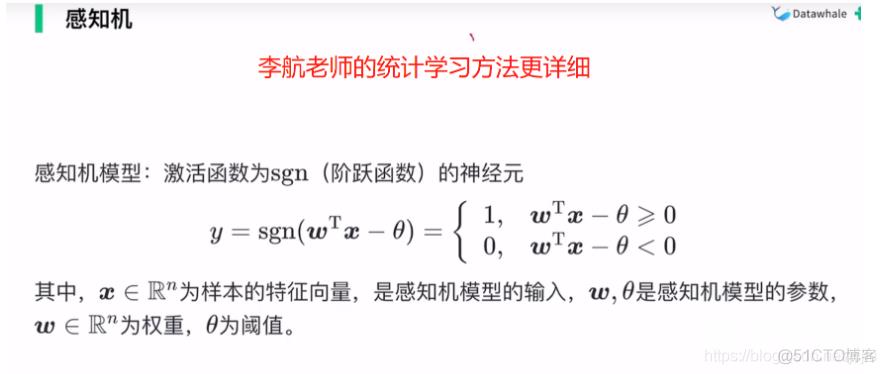

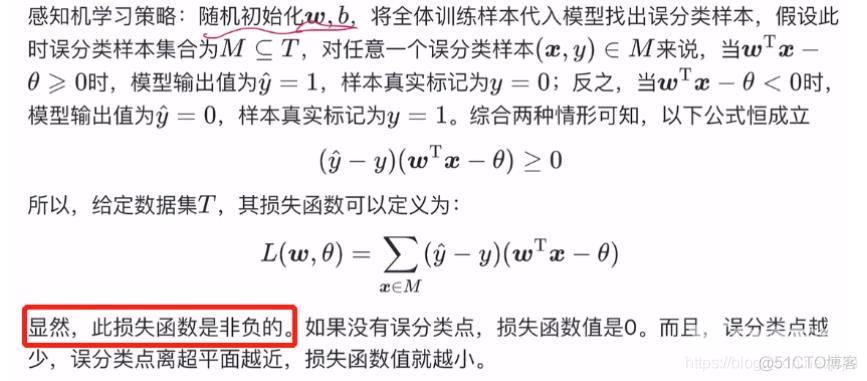

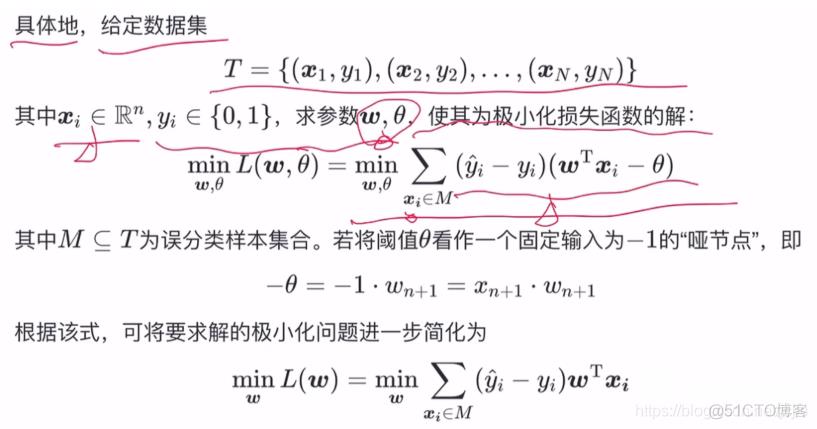

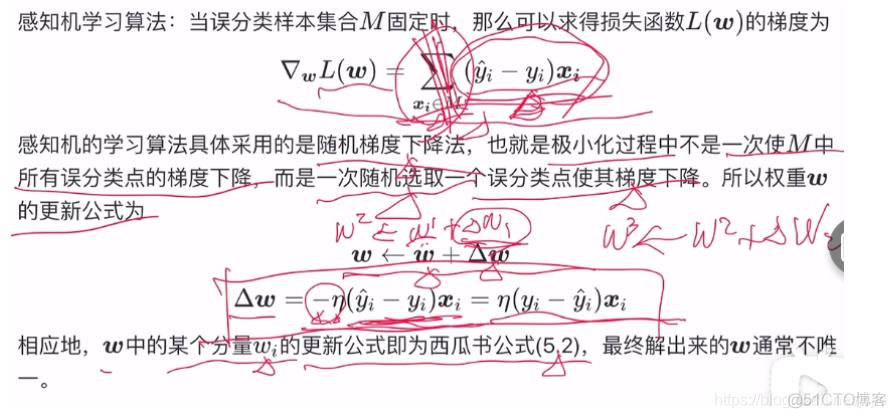

1.2 感知机

上面的模型输出值为1,真实标记为0,则y^-y=1 然后(wx---)这个是正空间,是大于0,我是这样理解的

这些内容应该是<<统计学习方法>>

"哑节点"应该是xi为-1,是已知,哑了(个人理解)

感知机的学习算法采用的是随机梯度下降法,终于搞懂这个学习率的东东了!nice

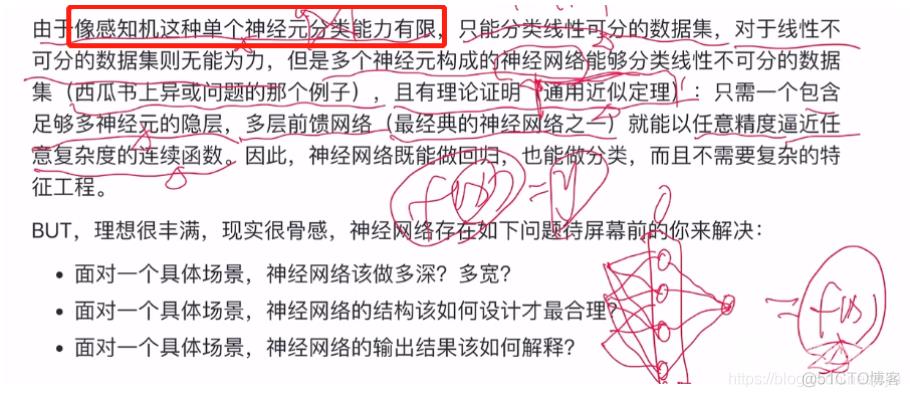

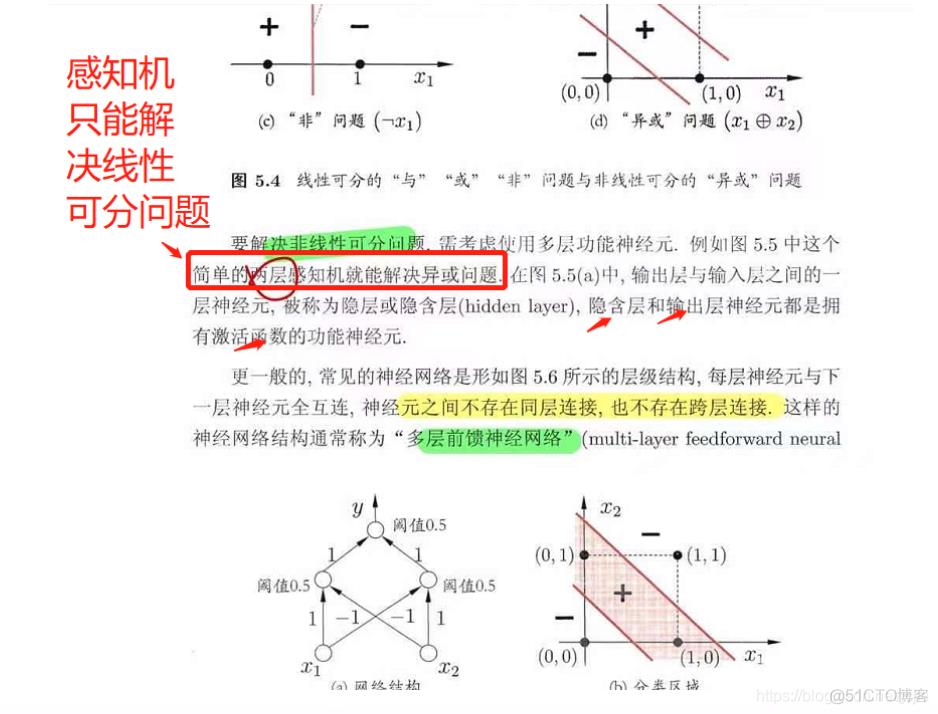

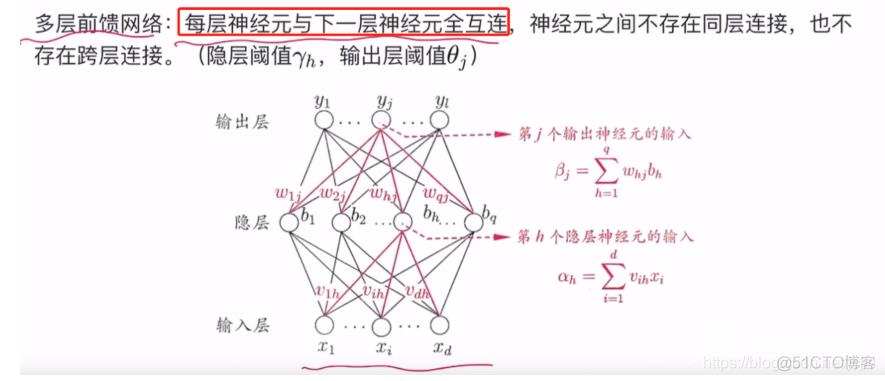

1.3 神经网络

隐含层和输出层神经网络都是拥有激活函数的功能神经元

神经网络可以做分类和回归

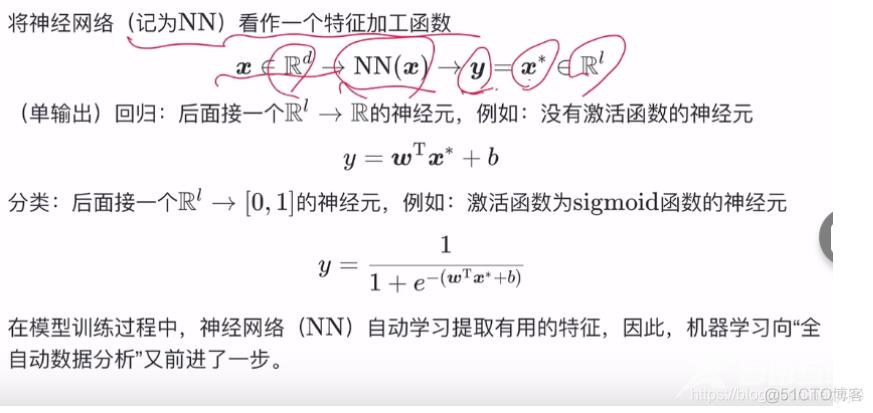

- 神经网络可以看作一个特征加工函数

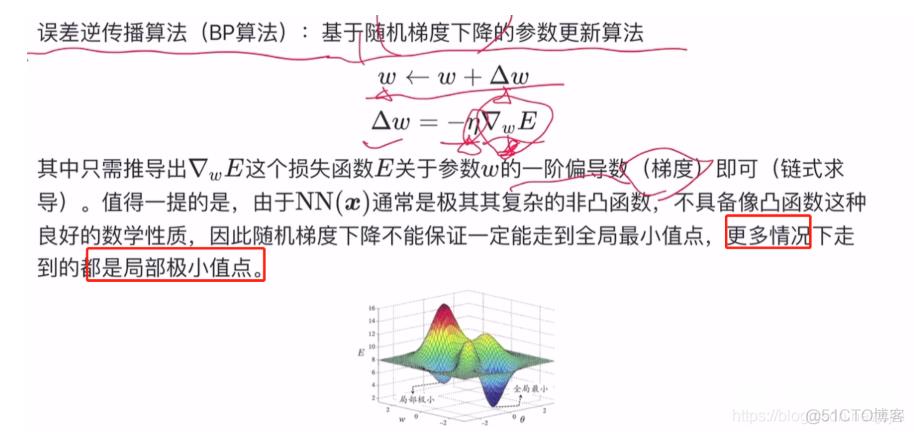

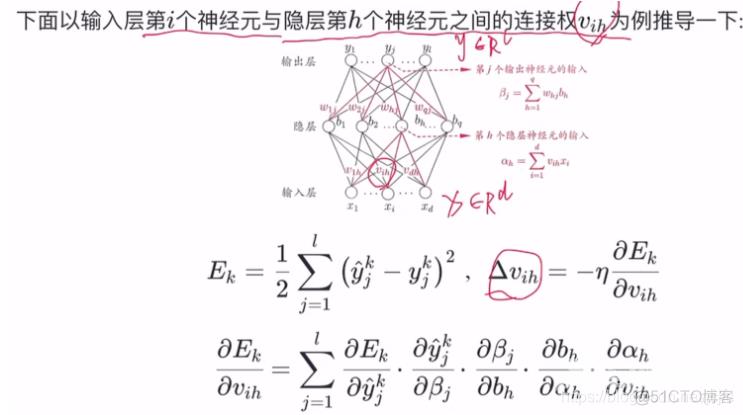

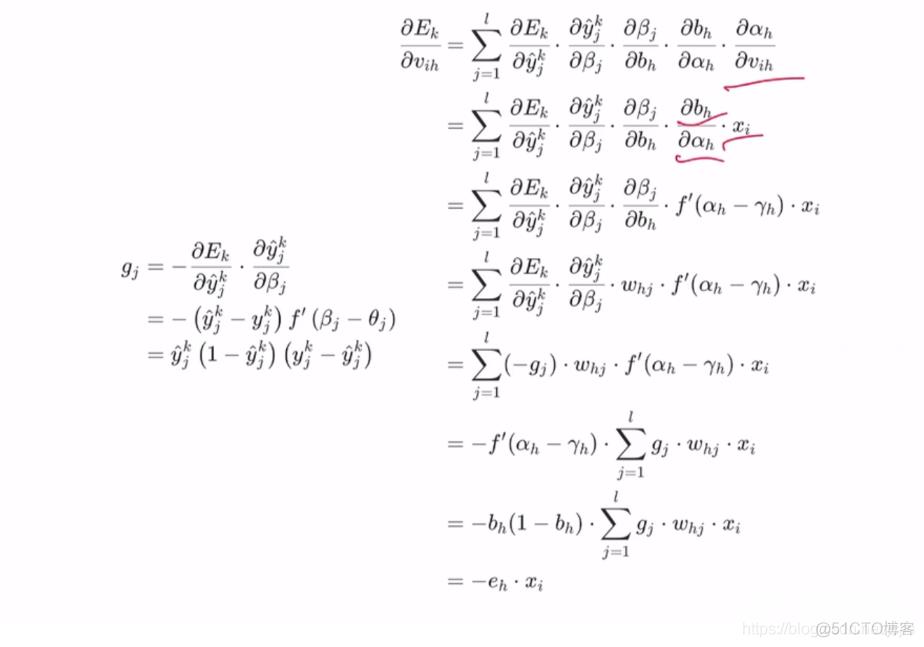

- 无限套娃,是个非凸函数,无法向线性回归那样求导,只能像BP算法基于随机梯度下降这种近似算法来求,使得损失函数得到最小值的w和b

- 分类也是用BP

- 自动学习有用特征(在优化,在强迫神经网络学习,想让你想好哈哈哈)

日渐复杂感觉

我的天了

强!群主

2 总结

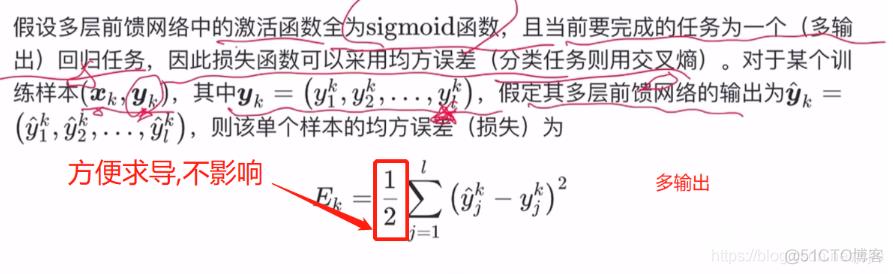

终于弄懂了BP神经网络,也明白了神经网络(NN)就是类似一个特征加工工厂,能提取出很多特征,这可能就是上分的特征。但是由于多层网络的构建,导致这不是非凸函数,无法像线性模型一样,是凸函数梯度下降求导w和b从而使模型求解,神经网络用的是BP随机梯度下降的方式来解决,经常得到的是局部最优解,因为有很多坑。

与吴恩达老师B站的可以相辅相成,相互验证,一起学吧,个人感觉

【文章原创作者大丰网页制作公司 http://www.1234xp.com/dafeng.html 欢迎留下您的宝贵建议】