统计学习——朴素贝叶斯法

1.朴素贝叶斯法介绍

统计学习——朴素贝叶斯法

1.朴素贝叶斯法介绍

朴素贝叶斯(naive Bayes)法是基于贝叶斯定理与特征条件独立假设的分类方法。对于给定的训练数据集,首先基于特征条件独立假设学习输入/输出的联合概率分布\(P(X,Y)\);然后基于此模型,对给定的输入\(x\),利用贝叶斯定理求出后验概率最大的输出\(y\)。朴素贝叶斯法实现简单,学习与预测的效率都很高,是一种常用的方法。

2.朴素贝叶斯法相关统计知识 贝叶斯法的思想可以概括为先验概率+输入数据=后验概率。下面就简单介绍后验概率公式的简单推导。

条件独立公式,如果\(x\)和\(y\)相互独立,则有:

条件概率公式:

\[P(Y|X) = \frac{P(X,Y)}{P(X)} \]\[P(X|Y) = \frac{P(X,Y)}{P(Y)} \]也即:

\[P(Y|X) = \frac{P(X|Y)P(Y)}{P(X)} \]全概率公式:

\[P(X) = \sum_{k}P(X|Y=y_k)P(Y=y_k)其中\sum_k P(Y= y_K)=1 \]从上面公式很容易得出贝叶斯公式:

\[P(Y=y_k|X) = \frac{P(X|Y=y_k)P(Y=y_k)}{\sum\limits_k P(X|Y = y_k)P(Y=y_k)} \]3.朴素贝叶斯法的学习与分类 3.1基本模型设输入空间\(x \subseteq R^n\),输出空间为类标记集合\(Y=\{c_1,c_2,···,c_k\}\)。\(P(X,Y)\)是\(X\)和\(Y\)的联合概率分布。训练数据集

\[T = \{(x_1,y_1),(x_2,y_2),···,(x_n,y_n)\} \] 由\(P(X,Y)\)独立同分布产生。

朴素贝叶斯学习\(P(X,Y)\),具体地,学习一下先验概率分布及条件概率分布。先验概率分布

条件概率分布

\[P(X = x|Y =c_k) = P(X^{(1)}=x^{(1)},···,X^{(n)}=x^{(n)}| Y=c_k),k=1,2,···,K \tag{2} \] \((1)\times(2)\),便可得到联合概率分布\(P(X,Y=c_k)\)。

从上面的式子可以看出\(P(Y=c_k)\)可以用极大似然估计求出,得到的\(P(Y=c_k)\)就是类别\(c_k\)在训练集里面出现的频数。但是\(P(X^{(1)}=x^{(1)},···,X^{(n)}=x^{(n)}| Y=c_k)\)是一个有n个维度的条件分布,是很难求出的,于是朴素贝叶斯法对条件概率分布作了条件独立性的假设,即\(X\)的n个维度之间相互独立,这样就可以得出:

从上式可以看出,这个很难的条件分布大大的简化了,但是这也可能带来预测的不准确性。你会说如果我的特征之间非常不独立怎么办?如果真是非常不独立的话,那就尽量不要使用朴素贝叶斯模型了,考虑使用其他的分类方法比较好。但是一般情况下,样本的特征之间独立这个条件的确是弱成立的,尤其是数据量非常大的时候。虽然我们牺牲了准确性,但是得到的好处是模型的条件分布的计算大大简化了,朴素贝叶斯法实际上学习到生成数据的机制,属于生成模型。

朴素贝叶斯分类时,对给定的输入x,通过学习到的模型计算后验概率分布\(P(Y=c_k|X=x)\),将后验概率最大的类作为x的输出。后验概率计算根据贝叶斯定理:

将\((3)\)代入式\((4)\)有

\[P(Y=c_k|X=x)=\frac{P(Y=c_k)\prod\limits_{i=1}^nP(X^{(i)} = x^{(i)}|Y=c_k)}{\sum\limits_kP(Y=c_k)\prod\limits_{i}^nP(X^{(i)} = x^{(i)}|Y=c_k)} \tag{5} \]注意到\((5)\)中所有分母对所有\(c_k\)都是相同的,所以比较时只要比较分子即可,于是朴素贝叶斯分类器可表示为

\[y=arg~\max_{c_k}P(Y = c_k)\prod_{i=1}^n P(X^{(i)} = x^{(i)}|Y=c_k)\tag{6} \]3.2朴素贝叶斯法的参数估计 对于\(P(Y=c_k)\),我们采用极大似然估计,很容易得到\(P(Y=c_k)\)为样本类别\(c_k\)出现的频率,即样本类别\(c_k\)出现的次数\(m_k\)除以样本总数\(m\)。

设第\(j\)个特征\(X^{(j)}\)可能取值的集合为\(\{a_{j1},a_{j2},···,a_{js}\}\),条件概率\(P(X^{(j)} = a_{jl}|Y=c_k)\)的极大似然估计是

下面给出朴素贝叶斯的学习与分类算法。

算法

输入:训练数据

其中\(x_i = (x_i^{(1)},x_i^{(2)},···,x_i^{(n)})\),\(x_i^{(j)}\)是第\(i\)个样本的第\(j\)个特征;\(x_i^{(j)}\in\{a_{j1},a_{j2},···,a_{js}\}\),\(a_{jl}\)是第\(j\)个特征可能取的第\(l\)个值,\(l = 1,2,···,s\),\(y_i\in\{c_1,c_2,···,c_k\}\);

输出:实例\(x\)的分类。

(1) 计算先验概率及条件概率,某些时候,可能某些类别在样本中没有出现,会导致分子为0,这样会影响后验的估计,为了解决这种情况,我们引入拉普拉斯平滑(Laplace Smooth)

式中\(\lambda\geq0\)。等价于在随机变量各个取值的频数上赋予一个正数\(\lambda\)。当\(\lambda=0\)时,就是极大似然估计。常取\(\lambda = 1\),这时称为拉普拉斯平滑。

(2) 对于给定的实例\(x=(x^{(1)},x^{(2)},···,x^{(n)})^T\),计算

(3) 确定实例\(x\)的类

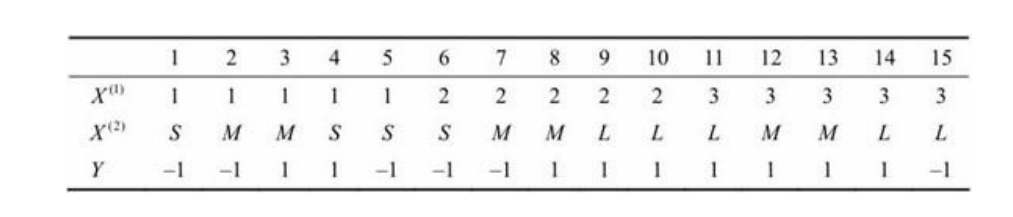

\[y= arg~\max_{c_k}~P(Y=c_k)\prod_{j=1}^nP(X^{(j)} = x^{(j)}|Y = c_k) \]例:试由表格中训练数据学习一个朴素贝叶斯分类器并确定\(x=(2,S)^T\)的类标记\(y\)。表中\(X^{(1)}\),\(X^{(2)}\)为特征,取值的集合分别为\(A_1=\{1,2,3\}\),\(A_2=\{S,M,L\}\),\(Y\)为类标记,\(Y\in C=\{1,-1\}\)。

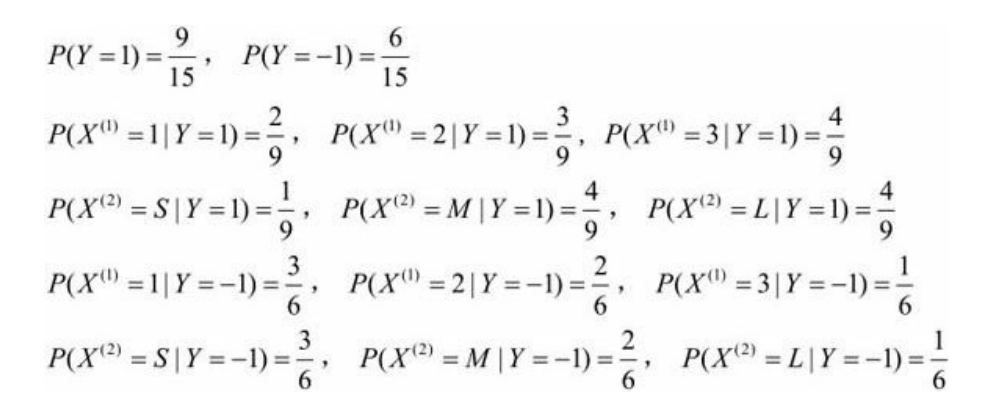

解:根据算法,有表格,容易计算出下列概率:

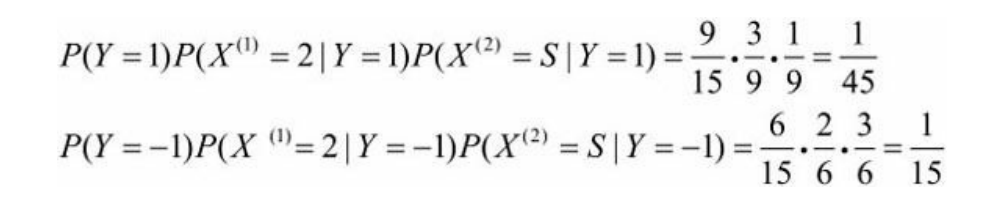

对于给定的\(x=(2,S)^T\),计算:

因为\(Y=-1\)的后验概率大,所以\(y=-1\)。

数据来源于sklearn.datasets中的load_iris()

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from collections import Counter

import math

# data

def create_data():

iris = load_iris()

df = pd.DataFrame(iris.data, columns=iris.feature_names)

df['label'] = iris.target

df.columns = ['sepal length', 'sepal width', 'petal length', 'petal width', 'label']

data = np.array(df.iloc[:100, :])

# print(data)

return data[:,:-1], data[:,-1]

X, y = create_data()

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3)

X_test[0], y_test[0]

(array([5.1, 3.8, 1.9, 0.4]), 0.0)#输入是一个4维向量,输出一个类别0或1

特征的可能性被假设为高斯

概率密度函数:

\[P(x_i | y_k)=\frac{1}{\sqrt{2\pi\sigma^2_{yk}}}exp(-\frac{(x_i-\mu_{yk})^2}{2\sigma^2_{yk}}) \]数学期望(mean):\(\mu\)

方差:\(\sigma^2=\frac{\sum(X-\mu)^2}{N}\)

class NaiveBayes:

def __init__(self):

self.model = None

# 数学期望

@staticmethod

def mean(X):

return sum(X) / float(len(X))

# 标准差(方差)

def stdev(self, X):

avg = self.mean(X)

return math.sqrt(sum([pow(x - avg, 2) for x in X]) / float(len(X)))

# 概率密度函数

def gaussian_probability(self, x, mean, stdev):

exponent = math.exp(-(math.pow(x - mean, 2) /

(2 * math.pow(stdev, 2))))

return (1 / (math.sqrt(2 * math.pi) * stdev)) * exponent

# 处理X_train

def summarize(self, train_data):

summaries = [(self.mean(i), self.stdev(i)) for i in zip(*train_data)]

return summaries

# 分类别求出数学期望和标准差

def fit(self, X, y):

labels = list(set(y))

data = {label: [] for label in labels}

for f, label in zip(X, y):

data[label].append(f)

self.model = {

label: self.summarize(value)

for label, value in data.items()

}

return 'gaussianNB train done!'

# 计算概率

def calculate_probabilities(self, input_data):

# summaries:{0.0: [(5.0, 0.37),(3.42, 0.40)], 1.0: [(5.8, 0.449),(2.7, 0.27)]}

# input_data:[1.1, 2.2]

probabilities = {}

for label, value in self.model.items():

probabilities[label] = 1

for i in range(len(value)):

mean, stdev = value[i]

probabilities[label] *= self.gaussian_probability(

input_data[i], mean, stdev)

return probabilities

# 类别

def predict(self, X_test):

# {0.0: 2.9680340789325763e-27, 1.0: 3.5749783019849535e-26}

label = sorted(

self.calculate_probabilities(X_test).items(),

key=lambda x: x[-1])[-1][0]

return label

def score(self, X_test, y_test):

right = 0

for X, y in zip(X_test, y_test):

label = self.predict(X)

if label == y:

right += 1

return right / float(len(X_test))

运行:

model = NaiveBayes()

model.fit(X_train, y_train)#'gaussianNB train done!'

print(model.predict([4.4, 3.2, 1.3, 0.2]))#0.0

print(model.score(X_test, y_test))#1.0

朴素贝叶斯是一类比较简单的算法,scikit-learn中朴素贝叶斯类库的使用也比较简单。相对于决策树,KNN之类的算法,朴素贝叶斯需要关注的参数是比较少的,这样也比较容易掌握。在scikit-learn中,一共有3个朴素贝叶斯的分类算法类。分别是GaussianNB,MultinomialNB和BernoulliNB。其中GaussianNB就是先验为高斯分布的朴素贝叶斯,MultinomialNB就是先验为多项式分布的朴素贝叶斯,而BernoulliNB就是先验为伯努利分布的朴素贝叶斯。

这三个类适用的分类场景各不相同,一般来说,如果样本特征的分布大部分是连续值,使用GaussianNB会比较好。如果如果样本特征的分大部分是多元离散值,使用MultinomialNB比较合适。而如果样本特征是二元离散值或者很稀疏的多元离散值,应该使用BernoulliNB。

4.2.1GaussianNB类特征的可能性被假设为高斯

概率密度函数:

\[P(x_i | y_k)=\frac{1}{\sqrt{2\pi\sigma^2_{yk}}}exp(-\frac{(x_i-\mu_{yk})^2}{2\sigma^2_{yk}}) \]数学期望(mean):\(\mu\)

方差:\(\sigma^2=\frac{\sum(X-\mu)^2}{N}\)

GaussianNB会根据训练集求出\(\mu_{yk}\)和\(\sigma^2_{yk}\)。

GaussianNB类的主要参数仅有一个,即先验概率priors ,对应Y的各个类别的先验概率\(P(Y=C_k)\)。这个值默认不给出,如果不给出此时\(P(Y=C_k)=m_k/m\)。其中\(m\)为训练集样本总数量,\(m_k\)为输出为第k类别的训练集样本数。如果给出的话就以priors 为准。

在使用GaussianNB的fit方法拟合数据后,我们可以进行预测。此时预测有三种方法,包括predict,predict_log_proba和predict_proba。

predict方法就是我们最常用的预测方法,直接给出测试集的预测类别输出。

predict_proba则不同,它会给出测试集样本在各个类别上预测的概率。

predict_log_proba和predict_proba类似,它会给出测试集样本在各个类别上预测的概率的一个对数转化。转化后predict_log_proba预测出的各个类别对数概率里的最大值对应的类别,也就是predict方法得到类别。

#"上面手动模拟的GS现用sklearn库实现

from sklearn.naive_bayes import GaussianNB

clf = GaussianNB()

clf.fit (X_train,y_train)

print(clf.score(X_test,y_test))

print(clf.predict([[4.4,3.2,1.3,0.2]]))

MultinomialNB假设特征的先验概率为多项式分布,即:

\[P(X_j=x_{jl}|Y = C_k)=\frac{x_{jl}+\lambda}{m_k+n\lambda} \] 其中,\(P(X_j=x_{jl}|Y = C_k)\)是第\(k\)个类别的第\(j\)维特征的第\(l\)个取值的条件概率。\(m_k\)是训练集中输出为第\(k\)类的样本个数。\(\lambda=1\),即拉普拉斯平滑。

MultinomialNB参数比GaussianNB多,但是一共也只有3个。其中,参数alpha即为上面的常数\(\lambda\),如果没有特别的需要,用默认的1即可。如果发现拟合的不好,需要调优时,可以选择稍大于1或者稍小于1的数。布尔参数fit_prior表示是否要考虑先验概率,如果是false,则所有的样本类别输出都有相同的类别先验概率。否则可以自己用第三个参数class_prior输入先验概率,或者不输入第三个参数class_prior让MultinomialNB自己从训练集样本来计算先验概率,此时的先验概率为\(P(Y=C_k)=m_k/m\)。其中\(m\)为训练集样本总数量,\(m_k\)为输出为第\(k\)类别的训练集样本数。总结如下:

在使用MultinomialNB的fit方法拟合数据后,我们可以进行预测。此时预测有三种方法,包括predict,predict_log_proba和predict_proba。方法和GaussianNB完全一样。

4.2.3BernoulliNB类BernoulliNB假设特征的先验概率为二元伯努利分布,即:

\[P(X_j=x_{jl}|Y=C_k)=P(j|Y=C_k)x_{jl}+(1−P(j|Y=C_k)(1−x_{jl}) \]此时\(l\)只有两种取值。\(x_{jl}\)只能取值\(0\)或者\(1\)。

BernoulliNB一共有4个参数,其中3个参数的名字和意义和MultinomialNB完全相同。唯一增加的一个参数是binarize。这个参数主要是用来帮BernoulliNB处理二项分布的,可以是数值或者不输入。如果不输入,则BernoulliNB认为每个数据特征都已经是二元的。否则的话,小于binarize的会归为一类,大于binarize的会归为另外一类。

在使用BernoulliNB的fit拟合数据后,我们

可以进行预测。此时预测有三种方法,包括predict,predict_log_proba和predict_proba。由于方法和GaussianNB完全一样。

朴素贝叶斯的主要优点有:

1)朴素贝叶斯模型发源于古典数学理论,有稳定的分类效率。

2)对小规模的数据表现很好,能个处理多分类任务,适合增量式训练,尤其是数据量超出内存时,我们可以一批批的去增量训练。

3)对缺失数据不太敏感,算法也比较简单,常用于文本分类。

朴素贝叶斯的主要缺点有:

1) 理论上,朴素贝叶斯模型与其他分类方法相比具有最小的误差率。但是实际上并非总是如此,这是因为朴素贝叶斯模型给定输出类别的情况下,假设属性之间相互独立,这个假设在实际应用中往往是不成立的,在属性个数比较多或者属性之间相关性较大时,分类效果不好。而在属性相关性较小时,朴素贝叶斯性能最为良好。对于这一点,有半朴素贝叶斯之类的算法通过考虑部分关联性适度改进。

2)需要知道先验概率,且先验概率很多时候取决于假设,假设的模型可以有很多种,因此在某些时候会由于假设的先验模型的原因导致预测效果不佳。

3)由于我们是通过先验和数据来决定后验的概率从而决定分类,所以分类决策存在一定的错误率。

4)对输入数据的表达形式很敏感。

6.参考文献1.刘建平机器学习

2.李航《统计学习方法》