XPath的使用点击跳转

使用Beautiful Soup4从HTML源代码中提取有用的信息

- 简介

- 语法讲解

- find和find_all

- select

简介

BeautifulSoup4(BS4)是Python的一个第三方库,用来从HTML和XML中提取数据。

BeautifulSoup4在某些方面比XPath易懂,但是不如XPath简洁,而且由于它是使用Python开发的,因此速度比XPath慢。

使用pip命令安装:pip install beautifulsoup4

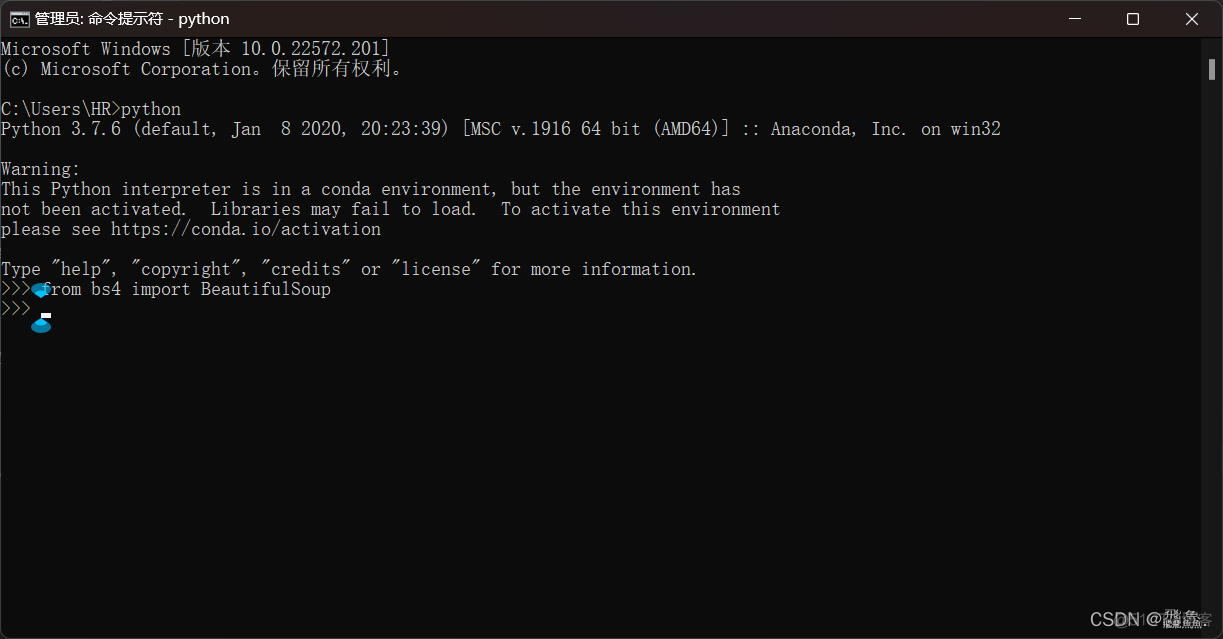

安装后,切换到Python的交互窗口,输入from bs4 import BeautifulSoup,如果没有报错则说明安装成功

语法讲解

使用Beautiful Soup4提取HTML内容,一般要经过以下两步。

- 处理源代码生成BeautifulSoup对象。

- 使用find_all()或者find()来查找内容。

源代码解析

- 解析源代码生成BeautifulSoup对象,使用以下的代码格式 soup = BeautifulSoup(网页源代码,'解析器')

- 这里的解析器可以写成html.parser,如果你安装了lxml,还可以写成lxml soup = BeautifulSoup(source, 'lxml')

soup = BeautifulSoup(source, 'html.parser')

find和find_all

find和find_all的区别就是前者会返回第一个满足条件的数据,后者返回全部满足条件的数据

查找内容

查找内容的基本流程和使用XPath非常相似。首先要找到包含特殊属性值的标签,并使用这个标签来寻找内容。

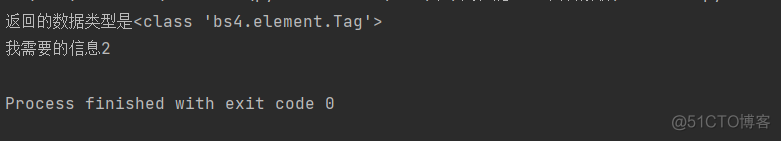

假设需要获取“我需要的信息2”,由于这个信息所在< li >标签的class属性的值为“test”,这个值本身就很特殊,因此可以直接通过这个值来进行定位.

from bs4 import BeautifulSoup

source = '''

<html>

<head>

<title>测试</title>

</head>

<body>

<div class="useful">

<ul>

<li class="info">我需要的信息1</li>

<li class="test">我需要的信息2</li>

<li class="iamstrange">我需要的信息3</li>

</ul>

</div>

<div class="useless">

<ul>

<li class="info">垃圾1</li>

<li class="info">垃圾2</li>

</ul>

</div>

</body>

</html>

'''

soup = BeautifulSoup(source, 'lxml')

# soup = BeautifulSoup(source, 'html.parser')

info = soup.find(class_='test')

print(f'返回的数据类型是{type(info)}')

print(info.string)

由于HTML中的class属性与Python的class关键字相同,因此为了不产生冲突,BS4规定,如果遇到要查询class的情况,使用“class_”来代替。在查询HTML代码时,class属性的属性值为“test”的标签,得到find()方法返回的BeautifulSoupTag对象。可以直接通过.string属性就可以读出标签中的文字信息。

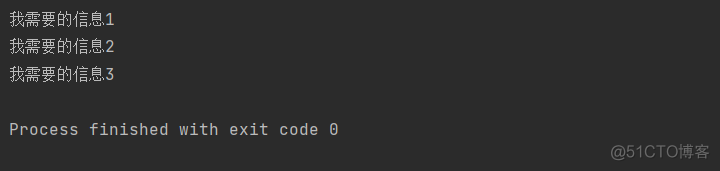

如果需要获取useful下的全部数据,先抓大再抓小依旧有效

useful = soup.find(class_='useful')

all_content = useful.find_all('li')

for li in all_content:

print(li.string)

找到以我需要开头的信息

content = soup.find_all(text=re.compile('我需要'))

for each in content:

print(each.string)对属性值的搜索也可以使用正则

content = soup.find_all(class_=re.compile('iam'))

for each in content:

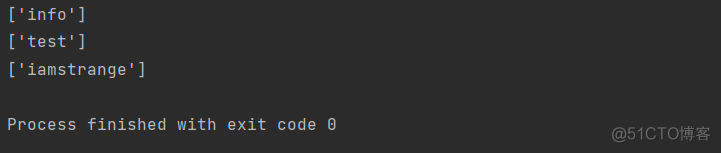

print(each.string)除了获取标签里面的文本外,BS4也可以获取标签里面的属性值。如果想获取某个属性值,可以将BeautifulSoup Tag对象看成字典,将属性名当作Key,返回的结果为列表

useful = soup.find(class_='useful')

all_content = useful.find_all('li')

for li in all_content:

print(li['class'])

跳转顶部

select

select的功能跟find和find_all 一样用来选取特定的标签,它的选取规则依赖于css,我们把它叫做css选择器

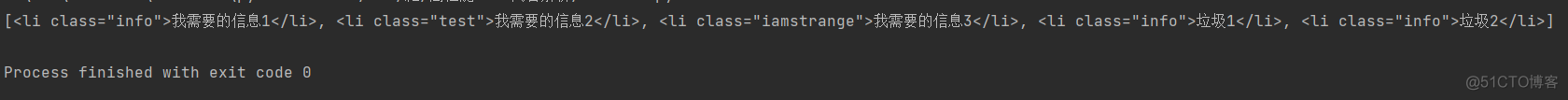

通过标签查找,返回含有此标签的语句会按照列表的形式返回

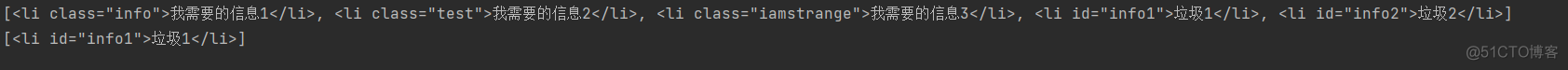

li_list = soup.select('li')print(li_list)

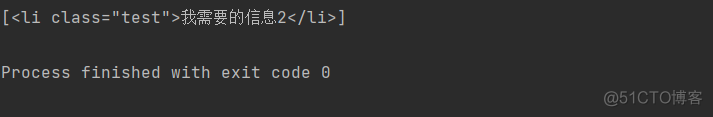

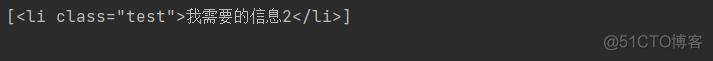

通过类名来查找

class_test = soup.select('.test')print(class_test)

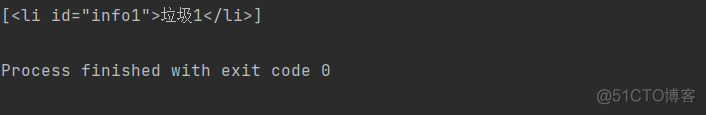

通过id名查找

我们将上面的HTML代码稍作修改

<html><head>

<title>测试</title>

</head>

<body>

<div class="useful">

<ul>

<li class="info">我需要的信息1</li>

<li class="test">我需要的信息2</li>

<li class="iamstrange">我需要的信息3</li>

</ul>

</div>

<div class="useless">

<ul>

<li class="id">垃圾1</li>

<li class="id">垃圾2</li>

</ul>

</div>

</body>

</html>id_info1 = soup.select('#info1')

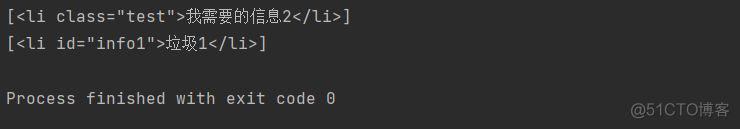

组合查找

组合查找,即是可以把标签名和类名、标签名和id名组合,但是中间要用空格隔开,组合查找,先查找满足标签的语句,再接着查找该语句下满足类名或者id的语句

li_class = soup.select('ul .test')

print(li_class)

li_id = soup.select('ul #info1')

print(li_id)

子标签查找

div_ul_li = soup.select('div > ul > li')div_ul_li_id_info1 = soup.select('div > ul #info1')

print(div_ul_li)

print(div_ul_li_id_info1)

属性查找

- 查找时还可以加入属性元素,属性需要用中括号括起来,注意属性和标签属于同一节点,所以中间不能加空格,否则会无法匹配到。 data = soup.select('ul li[class="test"]')

print(data)

跳转顶部